[LG]《Learning to Hint for Reinforcement Learning》Y Xia, C Xu, Z Yao, J McAuley… [University of California, San Diego & Snowflake AI Research] (2026)

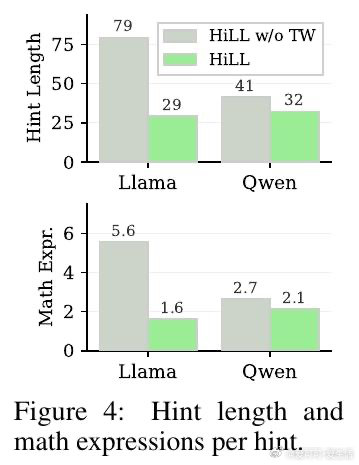

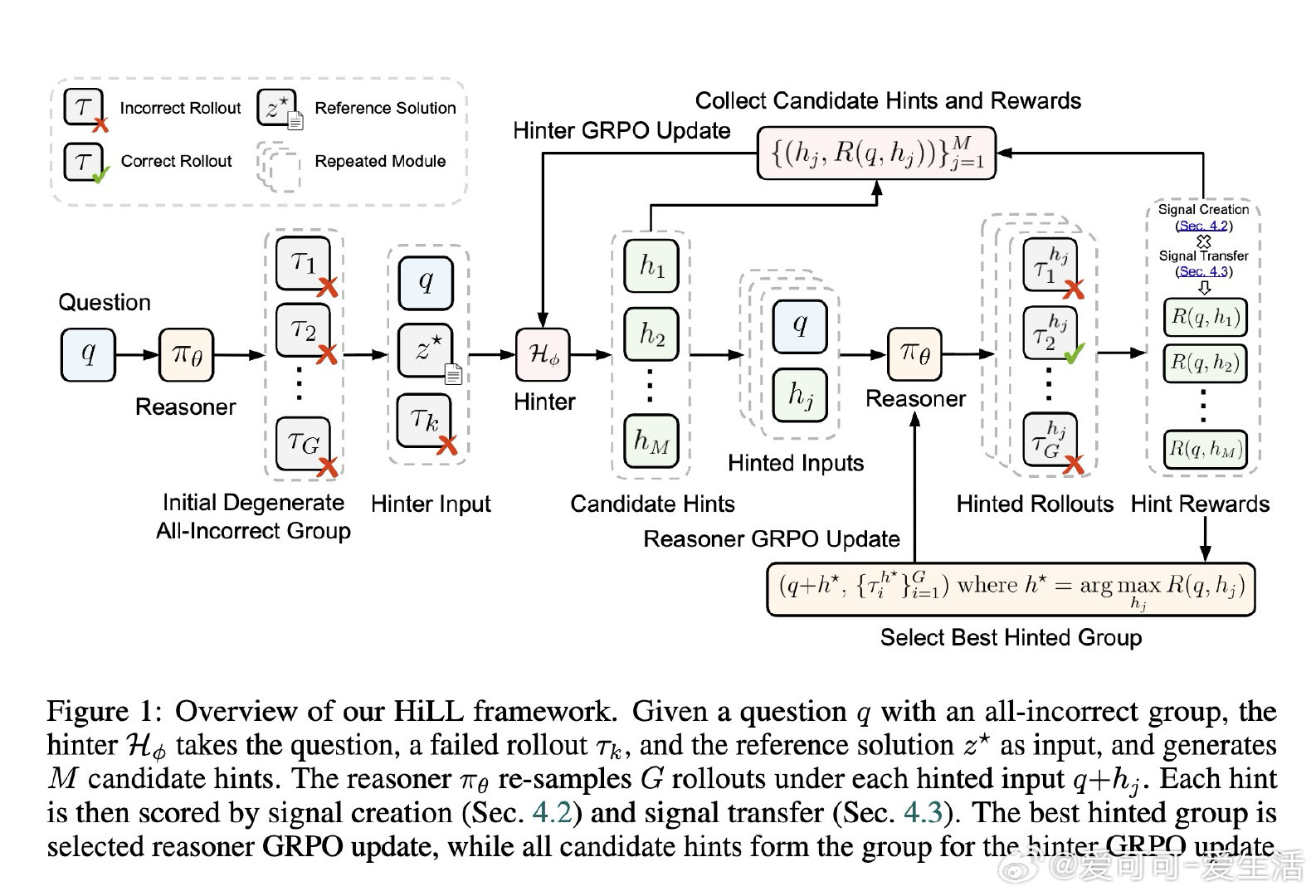

在强化学习训练大语言模型推理时,GRPO算法面临一个根本性的死局:当某道难题令模型所有采样均失败,组内相对优势归零,梯度消失,恰恰是最该被学习的题目反而提供不了任何训练信号。现有"加提示"的补救方案依赖固定的外部提示,既无法跟随模型能力的动态演化,也无法保证提示产生的正确轨迹在撤去提示后仍然有效——提示可能只是替模型做了关键步骤,而非真正提升了模型自身的推理能力。

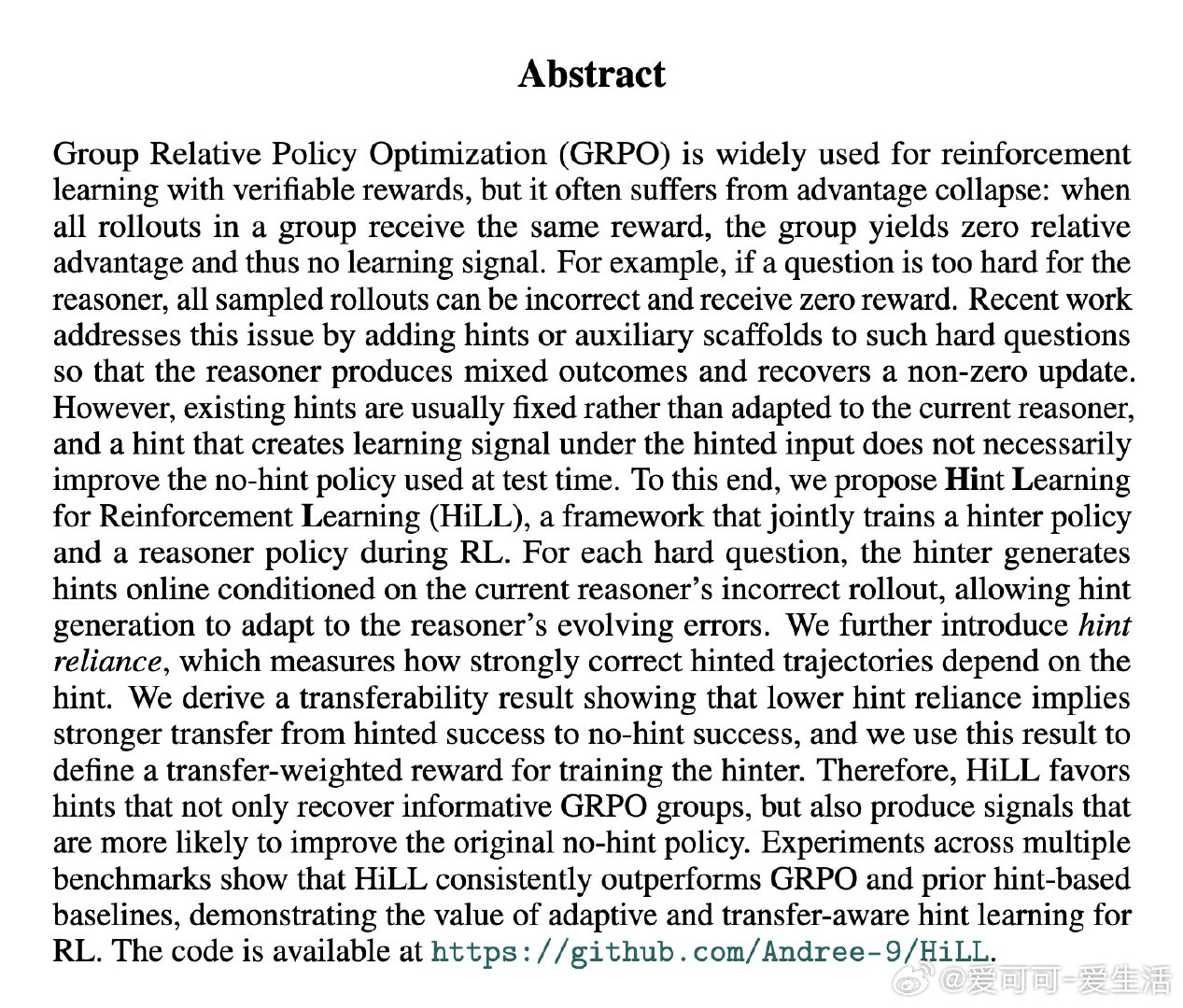

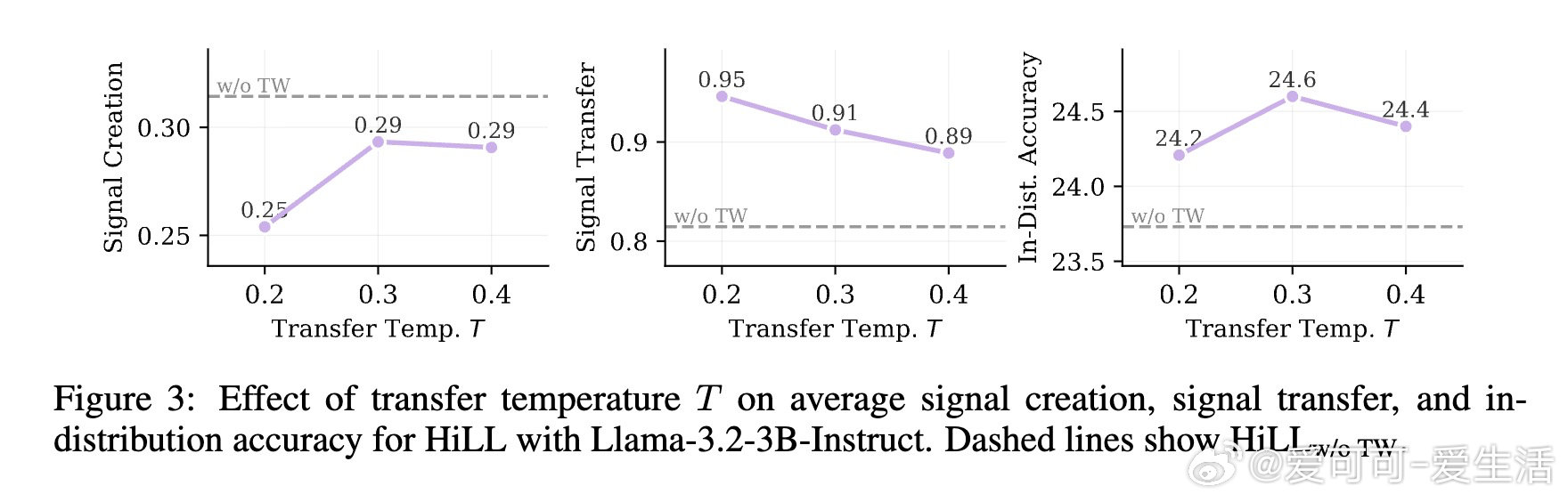

本文的核心洞见是:把"提示"本身重新看作一个可学习的策略,而非静态的外部资源。由此,HiLL框架引入了"提示依赖度"这一关键量——通过比较某条正确轨迹在有无提示两种条件下的对数似然差来度量模型对提示的依赖程度——并据此证明依赖度越低、无提示场景下的成功概率下界越紧。基于这一理论结果,hinter策略在奖励中同时考量"是否产生了混合结果组"与"正确轨迹是否可在无提示下自然复现",从而将产生信号与信号可迁移性统一进一个在线协同训练目标。

这项工作真正留下的遗产是:将提示从预处理步骤升格为与推理器协同进化的主动教学策略,并提供了一个可量化"教学有效性"的理论工具。它为后来者打开的新门是:如何系统地设计"脚手架式信号"——在训练时辅助、推理时撤去,同时保证辅助产生的梯度真正指向目标能力。但尚未跨过的门槛是:hinter的训练引入了约3倍的额外计算开销,且其泛化能力依赖于参考解的可获取性,这在更广泛的非数学推理场景中仍是未解的约束。

arxiv.org/abs/2604.00698

机器学习 人工智能 论文 AI创造营