前两天,有个在游戏公司做运营的朋友来找我聊。

他目前是在一家中型游戏公司负责用户增长,团队里大概有七八个人。

他最近很焦虑,因为老板开始频繁问他们实际工作里有没有在用AI。虽然他们现在也有尝试各种不同的AI工具,但主要还是用AI来做一些比较基础的活,比如活动文案、翻译反馈这些。

但这种方式,跟老板想要的AI驱动增长,还差得很远。

1我跟他聊完后一直在想,为什么大多数公司引入AI之后,感觉好像没什么区别?

以我朋友那个团队为例,他们用AI的方式有个根本性的误区,就是把AI当成了一个更聪明的搜索引擎。但这个模式,用来写文案、整理资料可以,但那些需要从头跑到尾的事情它办不了,还是需要自己去执行。

这个模式的瓶颈在于,所有的发现、判断和执行,都得靠人。AI只是在某个节点上帮你节省了一点时间,但整体的效率并没有提升多少。

以游戏运营为例,我最近看到ThinkingAI刚发布的一个产品演示里有一个场景。

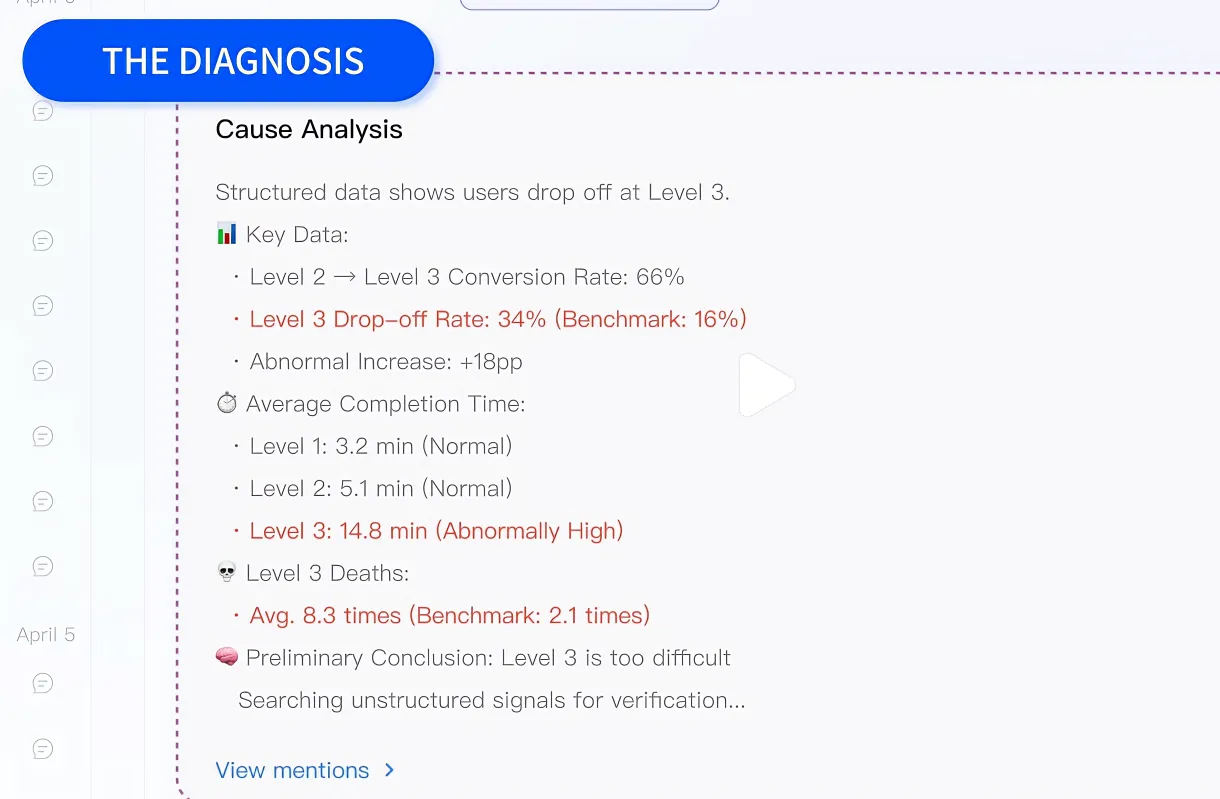

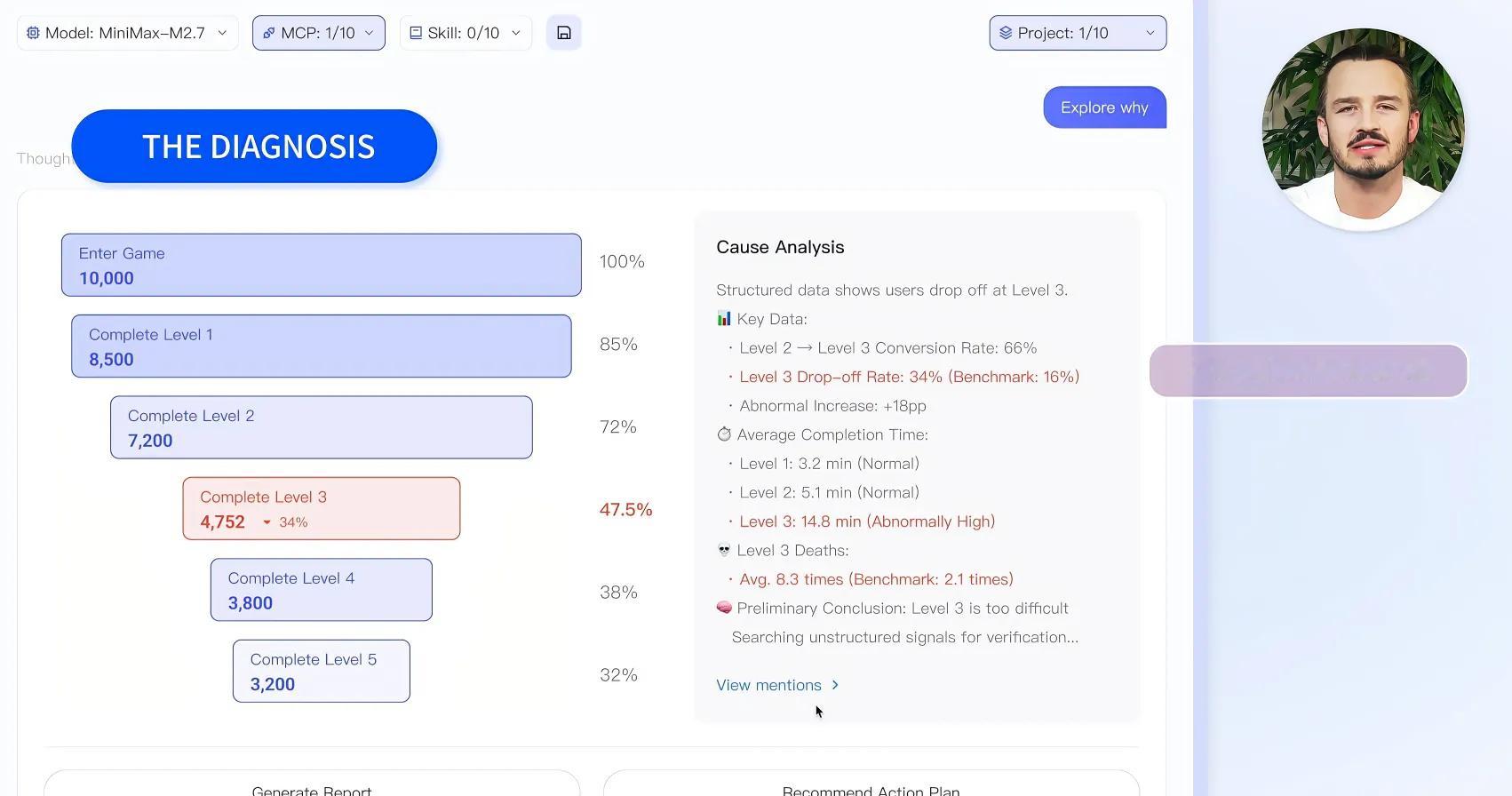

一家游戏公司,第七天留存率突然掉了12%,第三关的退出率涨了34%。

放在以前,这件事的处理流程大概是数据组先发现异常,拉数据,出报告,开会讨论,产品提需求,然后开发排期,测试上线,再等结果。这一圈走下来,快的话两周,慢的话一个月。

而在演示里,这个过程是怎么跑的呢?

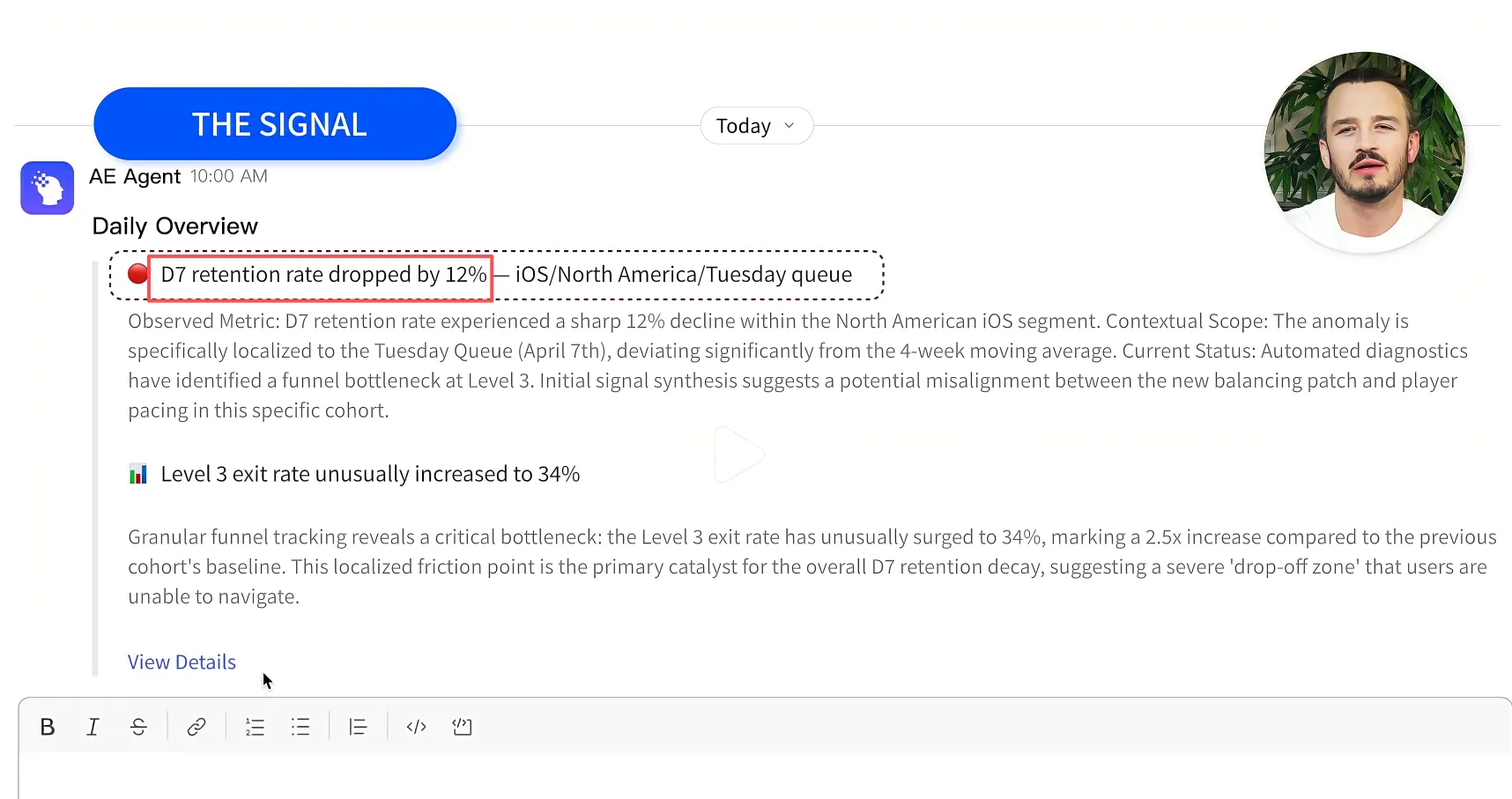

2还没等运营打开电脑,Slack里就已经收到了一条主动推送的消息,告诉你哪个指标异常了,数字是多少,影响了哪块收入。

然后你点进去,直接跟系统对话,问它为什么掉。

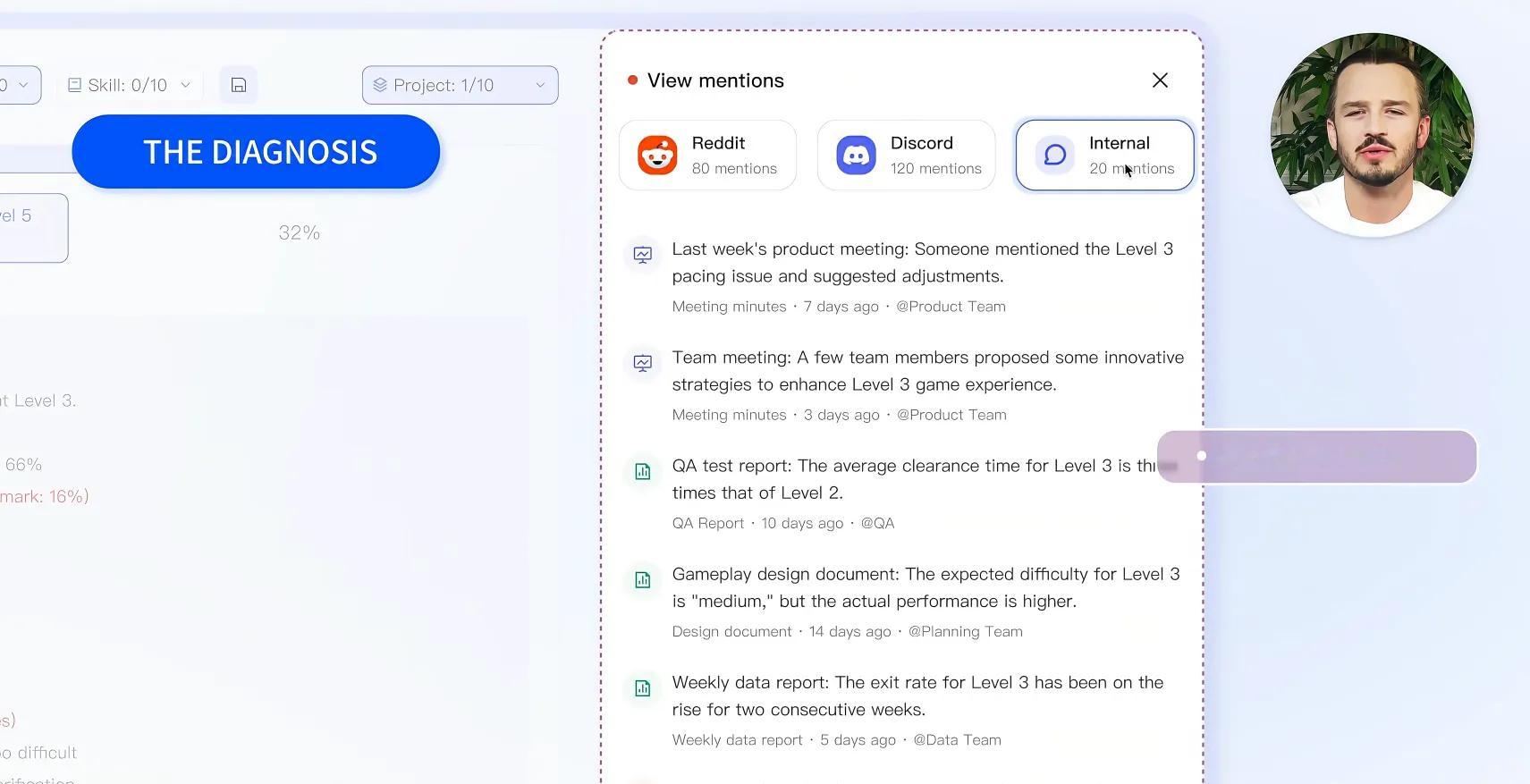

它去翻了游戏内的行为数据,又跑去看Reddit和Discord上玩家在说什么,同时还调取了内部的游戏设计文档,找到了一条过去被提过但没被重视的记录。

结论是:第三关难度突然拔高,玩家卡住了,流失就在那里。

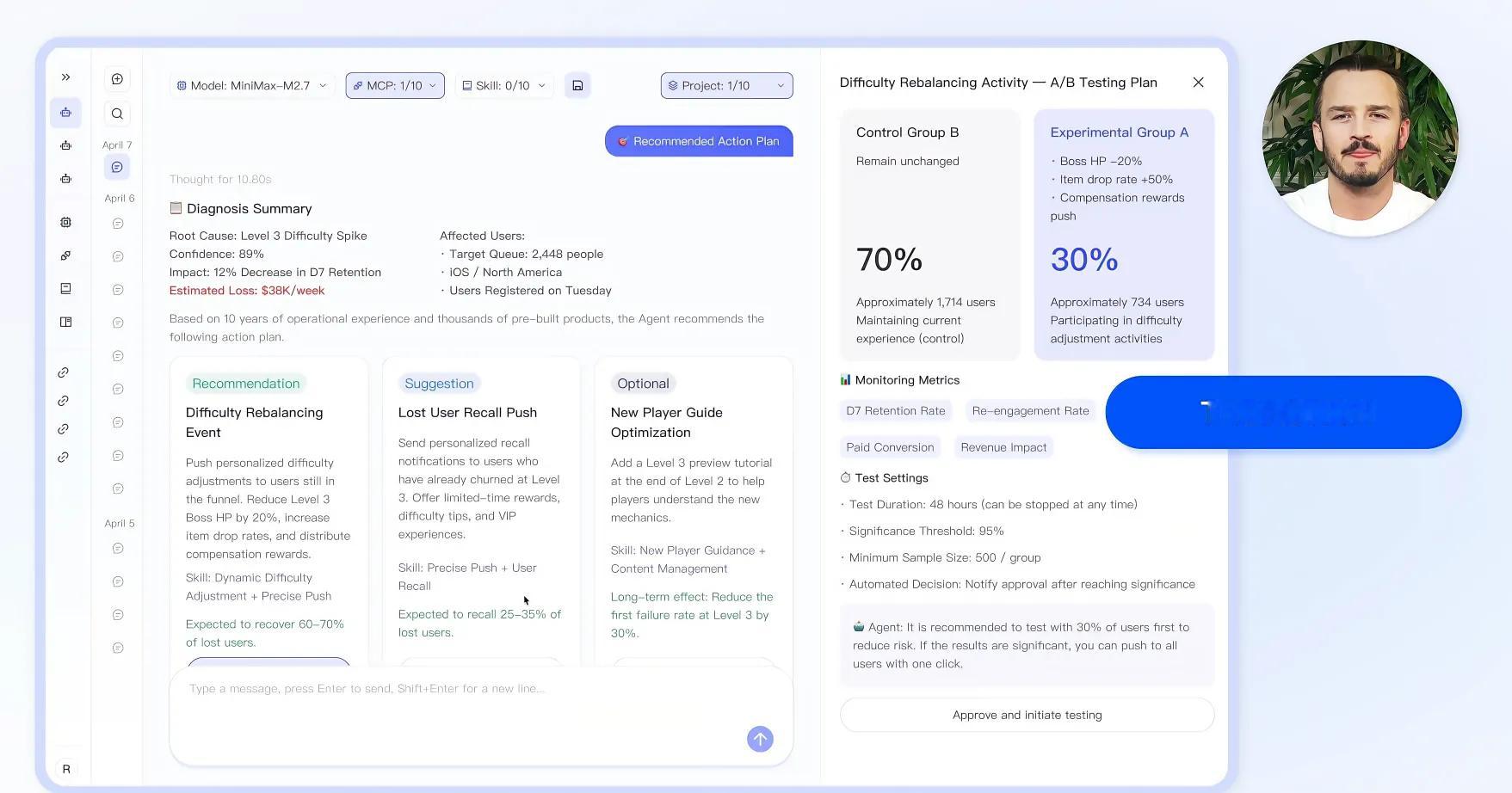

从发现问题,到定位原因,再到直接启动A/B测试,中间没有开会,没有写工单。六小时后,留存回来了,两天后问题基本恢复。

我当时看到这里,第一反应是:真的假的?而且我很好奇,这个流程里,到底哪些环节发生了本质性变化?

3我后来跟朋友聊到一个问题:为什么大模型没办法直接解决这个问题?

他们团队也试过直接调用GPT来做数据分析,但效果不稳定。同样的问题,有时候给的分析有用,但有时候就是纯输出废话。

主要原因在于,通用大模型不懂你的业务。它能理解自然语言,但它不知道你们这个游戏的数值设计,不清楚你们的核心用户群体有什么特征,也不了解你们产品之前做过的一些决策。

靠训练数据是解决不了这个问题的,必须靠真实项目的积累。

ThinkingAI在这个地方的优势,是他们背后有十年做数据分析和运营工具的积累,服务过1500多家企业,8000多个产品。最终,他们把这些经验沉淀成了行业专属的知识和判断框架。

4我跟朋友说,现在市面上很多公司说自己在做Agent,但大部分产品还是把大模型包一层壳,或者接入了几个工具调用。

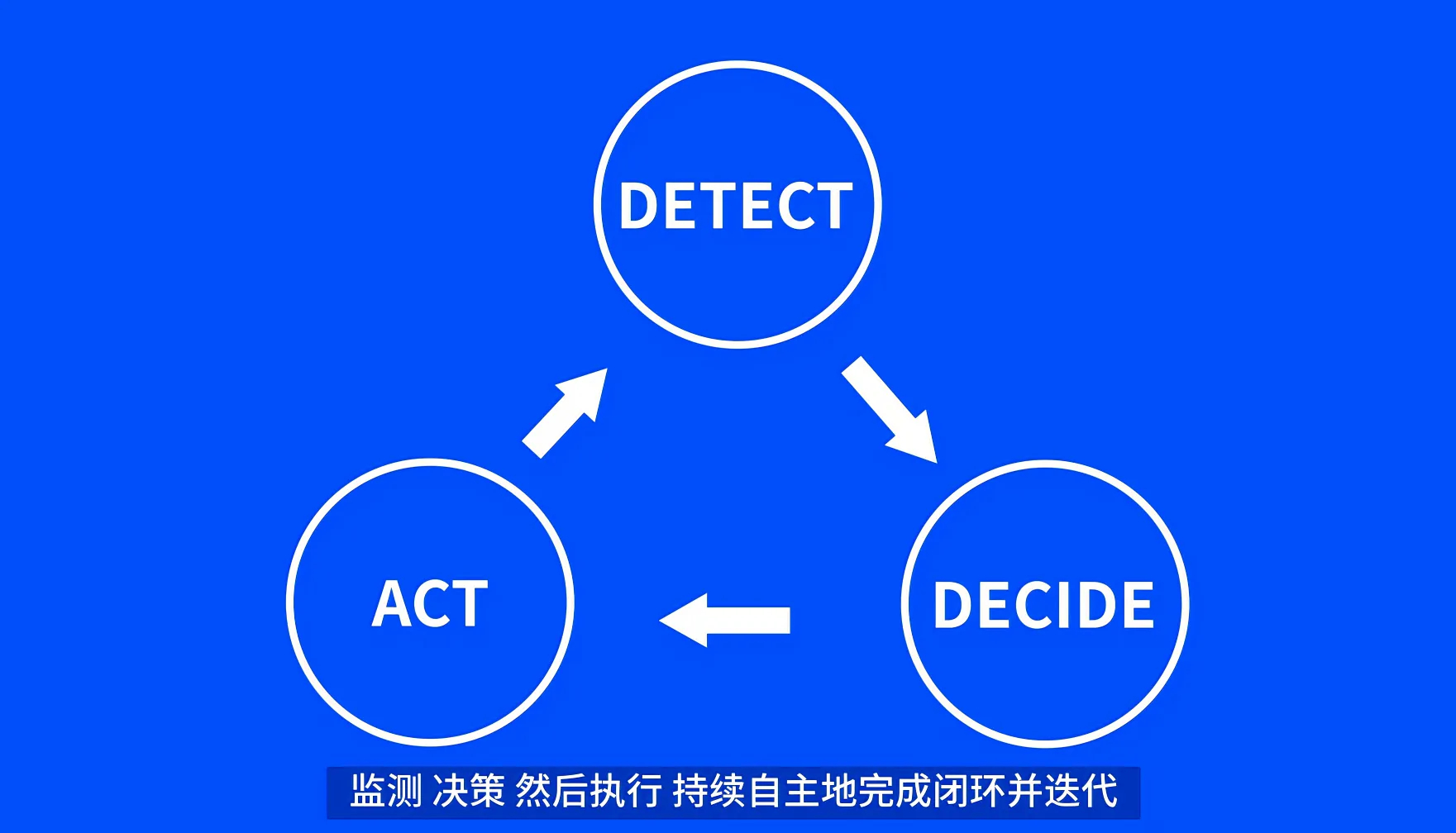

但真正意义上的Agent,应该是能自己发现问题,自己判断原因,然后自己把事情推进到结束。这三件事,发现、判断、执行,单独拎出来不算太难,但要同时在企业环境里跑通,还要保证数据安全、结果可控、不同人问同一个问题能得到一致的答案。

实现起来就完全是另一个量级的挑战了。

这也是为什么ThinkingAI选择做成一个可私有化部署的企业级平台,而不是做成一个SaaS工具。

数据不能出企业边界,这对很多公司来说是硬性要求,不解决这个问题,很多团队根本没办法把真实的业务数据接进去。

另外让我觉得这个产品想得比较清楚的地方,是他们处理风险的方式。新的Agent不是直接上生产环境的,先跑沙箱,测试没问题再部署;A/B测试要达到统计显著性才推广,不是说这个策略好就全量推。

5我朋友看完这个演示的第一反应不是兴奋,而是很焦虑:这种产品,是否会让他们团队缩编?但我觉得他不应该这么思考问题,因为如果竞争对手用了这样的工具,你们还继续用人工一个个盯数据的方式,两边的效率差距会有多大?

运营这个岗位的核心价值,是判断哪个方向值得做,策略是否有长期价值。但前提是,你得先把工具用起来。

完整的产品演示视频在ThinkingAI的官号上,感兴趣的朋友可以去看原片,直观很多。