3月底,一批Anthropic的Claude重度用户发现,标称5小时的使用额度,20分钟就烧光了。投诉涌上Reddit、GitHub和X。Anthropic的回应是:高峰时段,额度会消耗得更快。公司还限制了部分第三方工具调用其包月订阅额度。再往前几周,Claude Code的负责人Boris Cherny承认,模型默认的思考深度已经被调低了。

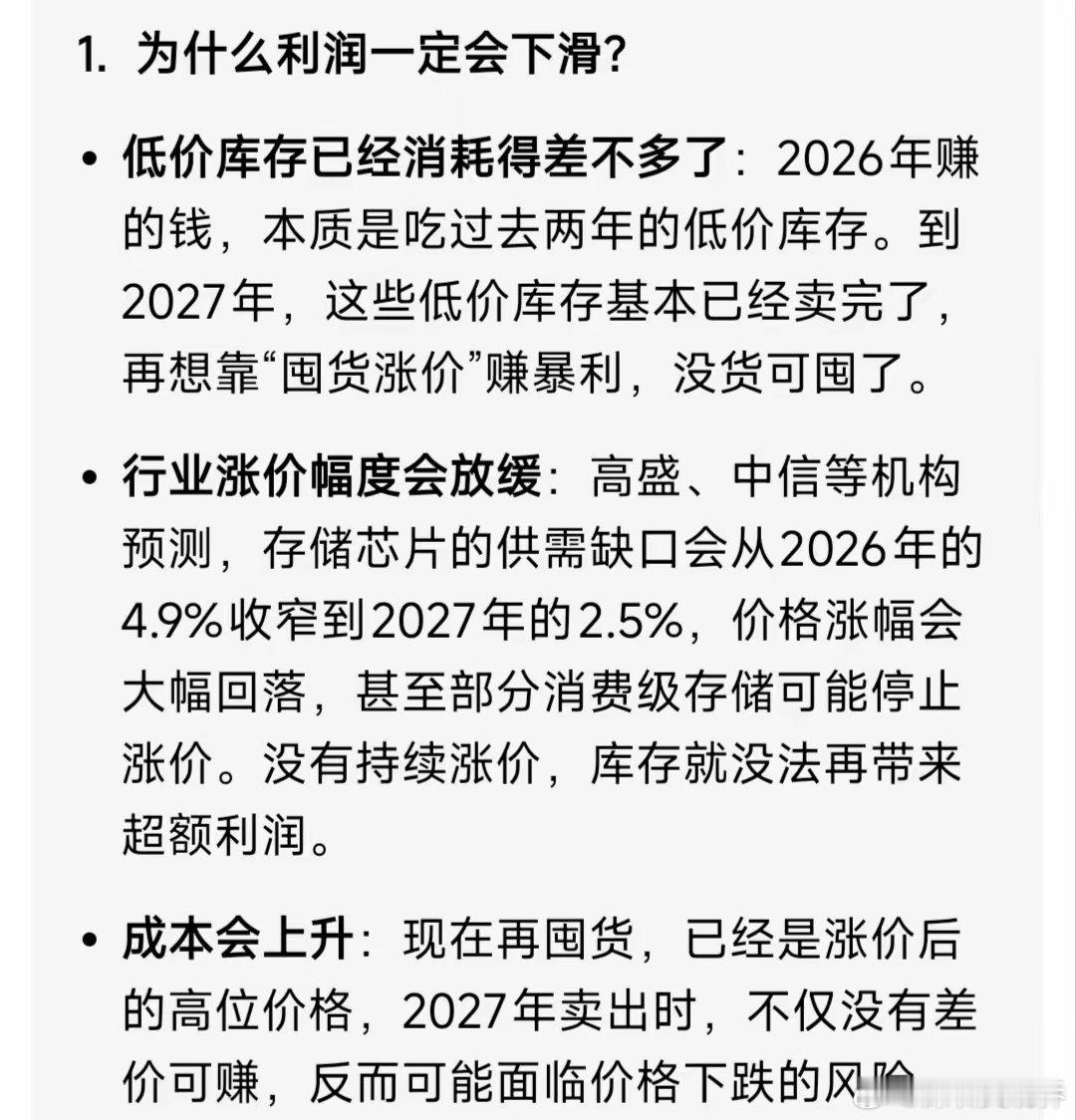

付费用户花一样的钱,得到的东西却在缩水。这不是某一家的问题。OpenAI开始关停视频生成平台Sora,其编程助手Codex的每周开发者数量则已升至400万。投资人和开发者开始谈论一个新词:算力荒。

AI和过去所有互联网服务有一个根本区别。你每月花20美元订阅Google Workspace,不管用多用少,Google的成本几乎没差别。但AI完全不同:你用10倍的量,供应商就要花10倍的钱。每一次对话、每一个token都在烧真金白银的芯片算力。20美元包月,很多人实际烧掉的远不止20美元。所以限速是必然的,这个商业模式从一开始就是亏的。

限速只是最表面的一层。往下看,这些公司还有别的手段。ChatGPT有个叫Auto的模式:你问天气,它派一个小模型秒回;你问复杂问题,它才出动大模型慢慢想。Anthropic则直接把默认模型换成更小更便宜的Sonnet。效果是一样的:用户拿到的智能降级了,但账面上的额度没变。用Lennart Heim的话说,很多人也确实在浪费算力,相当于请爱因斯坦帮你开瓶红酒。

Heim是AI算力领域最懂行的政策专家之一,曾在兰德公司领导算力研究,也是追踪前沿AI资源消耗的Epoch AI的联合创始人。他关心的问题是:当一个云端的仪表盘背后,必须对应一座真实的工厂、一条真实的输电线,会发生什么。

会发生的事情是:整条供应链全部卡住。

先卡在芯片。全球最先进AI芯片几乎都由台积电代工。台积电今年一年的扩产投资高达560亿美元,客户仍然嫌不够。但台积电的商业逻辑决定了它不可能无限扩产:一座新工厂如果开工率不到80%,公司就会破产。Sam Altman跑去说我要100倍的芯片,台积电的反应是:你疯了。

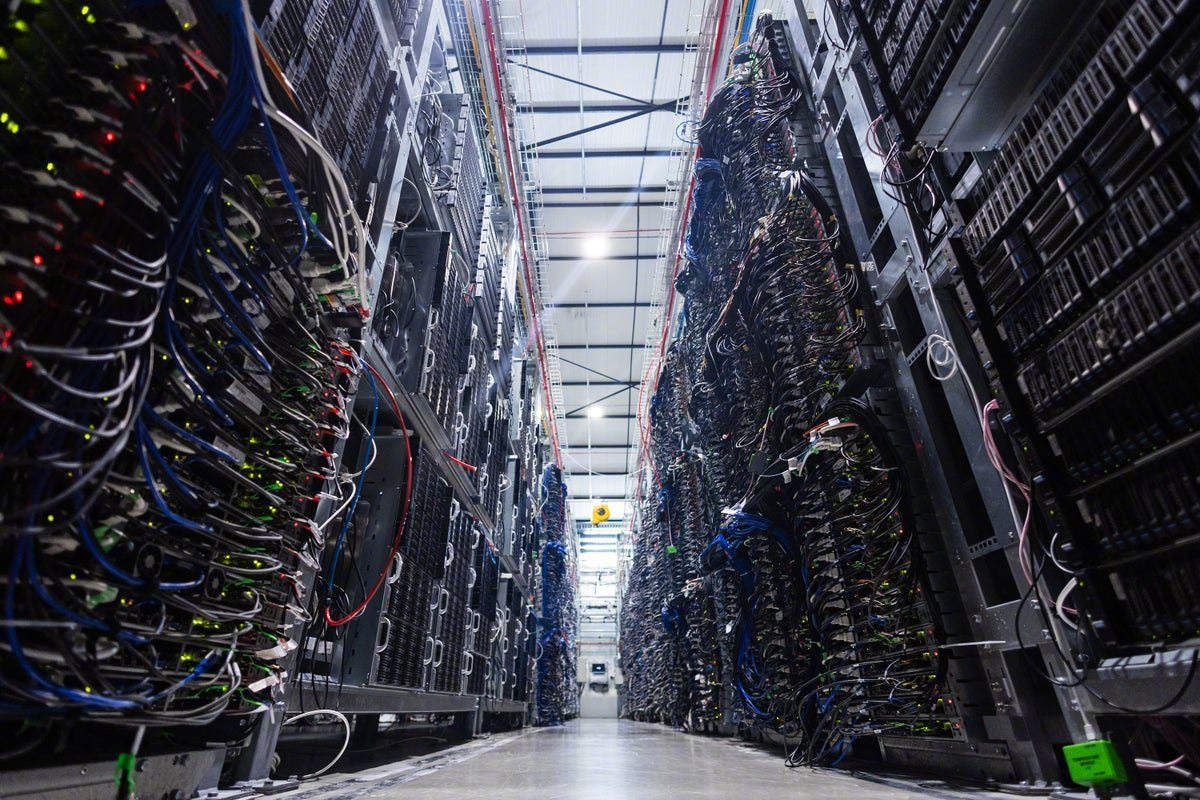

芯片只是第一道关。有了芯片,你需要电。Anthropic在一份白皮书中估算,到2028年,仅美国AI行业就需要至少50吉瓦的电力供应,相当于50座大型核电站的输出。国际能源署的预测是,全球数据中心用电量到2030年将翻一倍。你去找燃气轮机厂商说要大幅增产,人家的反应和台积电一样:这个行业过去10年都是平的,你突然要我翻几倍?

再往下,卡在内存。AI芯片要吃掉大量内存产能,直接后果是内存涨价,你明年买手机可能要多花钱。内存厂商想扩产,又发现没有足够的无尘车间。建无尘车间需要专门的晶圆厂建设公司,全世界能干这活的公司屈指可数,而且档期全满。

这就是数字世界撞上物理世界的声音。互联网公司过去可以在几周内扩容10倍、100倍,因为不受物理约束,这是硅谷的信仰。但如果明天AI用户突然多100倍,没有任何力量能变出足够的芯片、电力和厂房。

更麻烦的是,算力还要在两件事之间左右互搏:一边是给用户提供服务,一边是训练更大更强的下一代模型。推理算力白天用户活跃时飙升,训练算力则24小时不停。据估算,目前大约60%的算力花在研发上,这些公司一边想赚今天的钱,一边想用更强的模型去融明天的资。两边都在抢同一池子的GPU。

OpenAI目前比Anthropic宽裕,原因很直接:钱更多,估值更高,囤的算力更厚。就算OpenAI明天停止开发新模型,手里的算力储备也够它舒服很久。Anthropic则必须精打细算,因为数据中心极其昂贵,建多了是天价闲置,建少了用户就被限速。没人能准确预测需求。

Heim的判断是,未来相当长一段时间,算力都会处于紧缺状态。最终市场机制会发挥作用:涨价。但现在这些公司更倾向于限速而不是涨价,因为它们宁可让所有人都能用上、哪怕用得少一点,也不想把价格提到只有少数人用得起。

所以你在AI对话框里等待的那几秒钟,背后是台积电的工厂、发电用的天然气、内存厂商的无尘车间和英伟达的产能排期。20美元买不来无限智能。至少现在买不来。

~~~~~~

图源:SAMEER AL-DOUMY/AFP

信源:Béchard, Deni Ellis. "What is the AI compute crunch, and why are AI tools hitting usage limits?." Scientific American, edited by Eric Sullivan, 1 May 2026