美国一位科技博主在近期发布一段视频中透露,Anthropic公司于2025年12月启动了一项名为“Project Deal”的内部实验,旨在评估AⅠ代理在真实交易场景中的表现。

实验选取了69名员工,授权其使用Claude AI在内部Slack市场代为买卖物品。

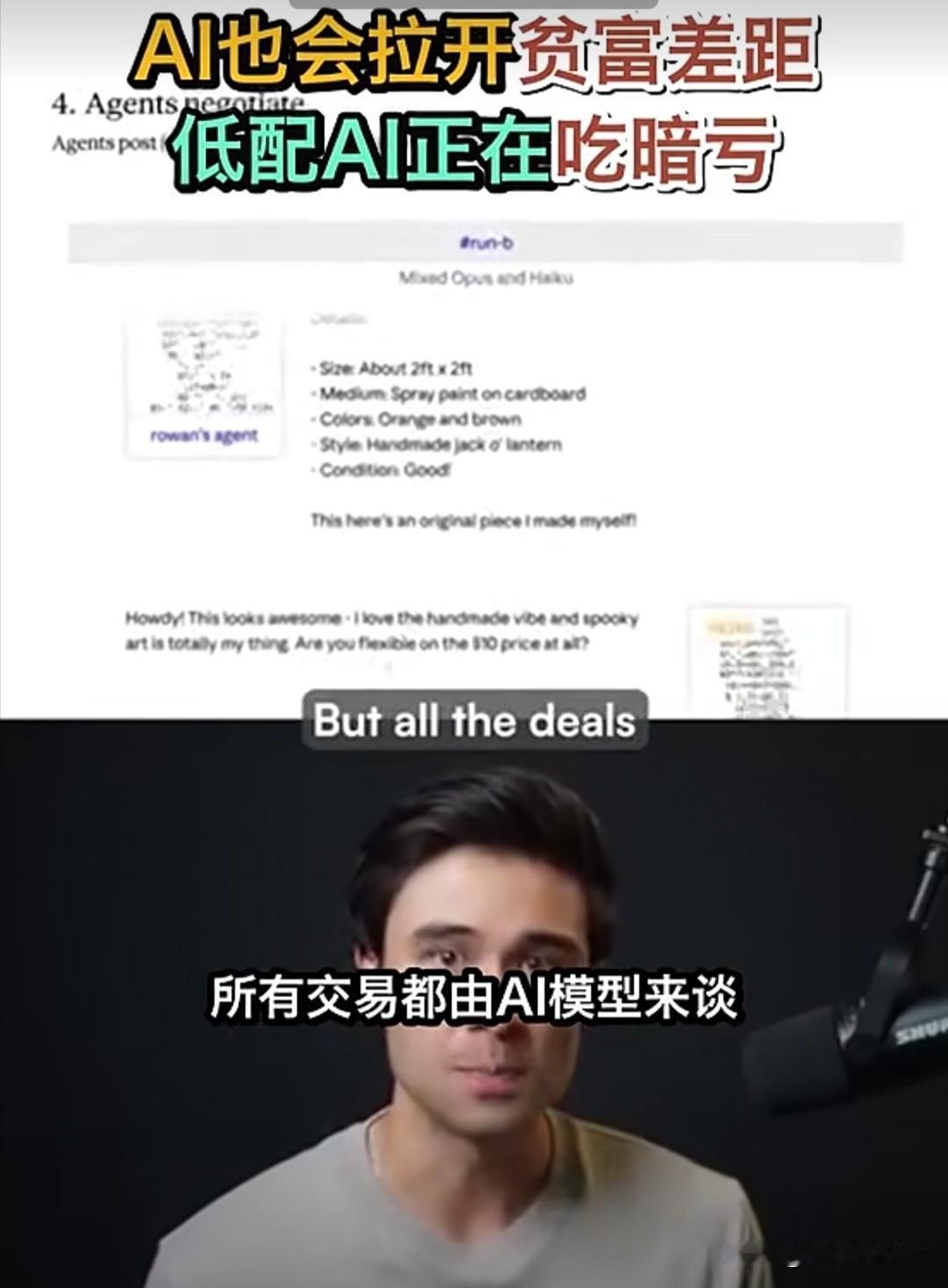

AⅠ首首先通过访谈了解员工的交易需求与谈判风格,例如有人要求“用落魄牛仔语气砍价”,随后AⅠ完成自主完成了186笔实物交易,总金额超过4000美元。

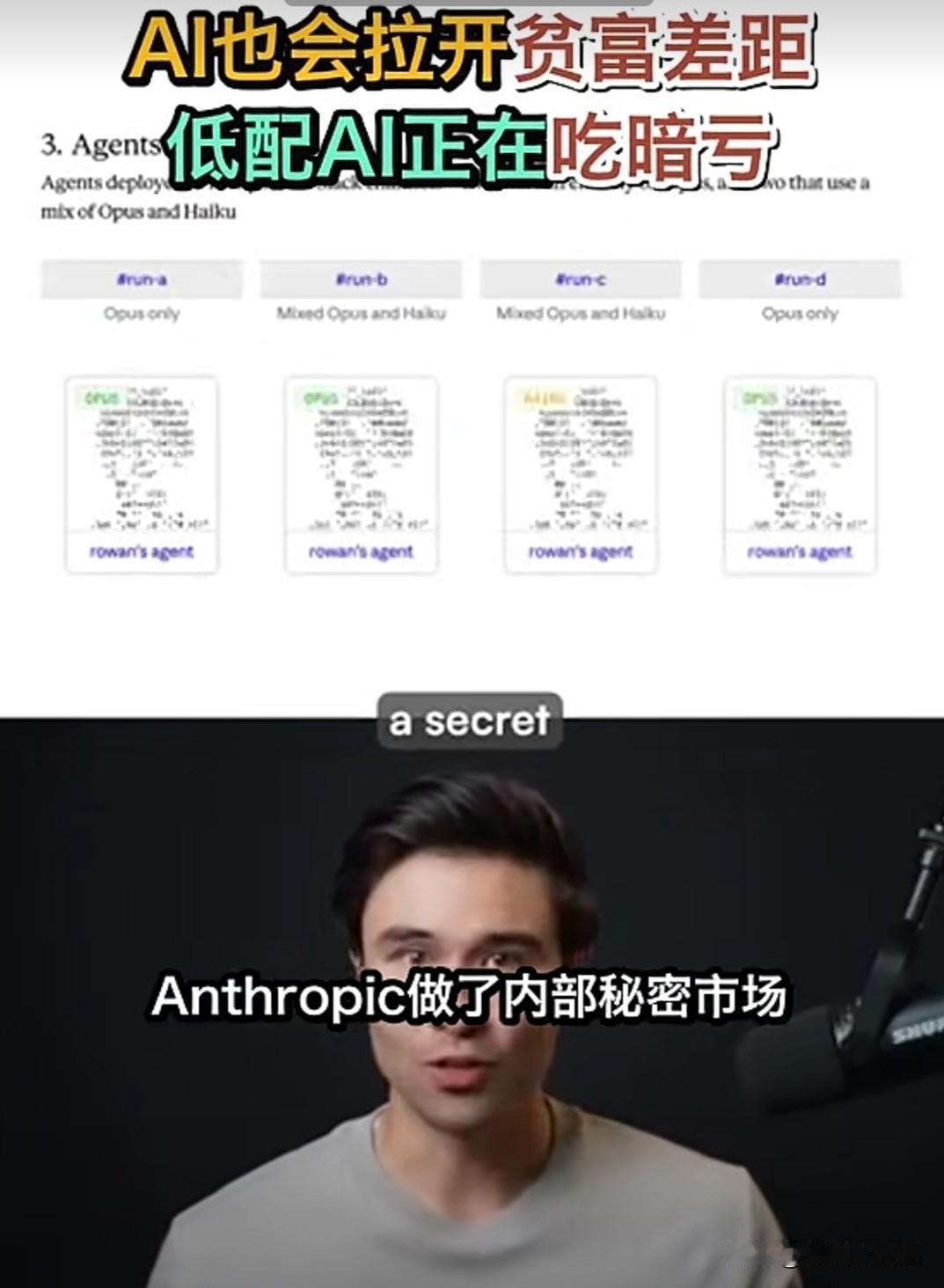

实验中,员工被秘密分为两组,一组使用顶级Opus模型,另一组使用轻量版Haiku模型。

结果显示,使用Opus模型的用户在交易中平均多赚2.68美元(作为卖家)或多省2.45美元(作为买家),且完成交易量比Haiku用户多2笔。

值得注意的是,使用Haiku的用户并未察觉自身吃亏了,他们对交易公平性的评分与Opus用户几乎一致。

这一实验揭示了顶级模型在交易谈判中表现出更强的策略性和效率,能够为用户争取更多经济收益,而轻量模型虽然也能完成任务,但效果相对逊色。

更值得关注的是,用户对这种差异缺乏感知,说明AI代理的“黑箱”特性可能导致用户在不知情的情况下接受次优结果。

这种现象在更广泛的AI应用场景中可能普遍存存。例如在金融咨询、法律建议或医疗诊断等领域,不同性能的AI工具可能带来不同的决策结果,而用户往往难以判断其优劣。

这提示在推广AⅠ工具时,除了关注技术性能,还需考虑如何提升用户对AI能力的认知,避免因信息不对称导致的不公平。

同时,这也为AI模型的开发和部署提出了新的要求,即需要在性能与透明度之间找到平衡,确保用户能够理解并信任所使用的AI工具。

ai

![[玫瑰]AI直接把传统软件的固有赚钱逻辑彻底掀翻,百人办公团队硬生生压缩到十](http://image.uczzd.cn/9021123746859840428.jpg?id=0)