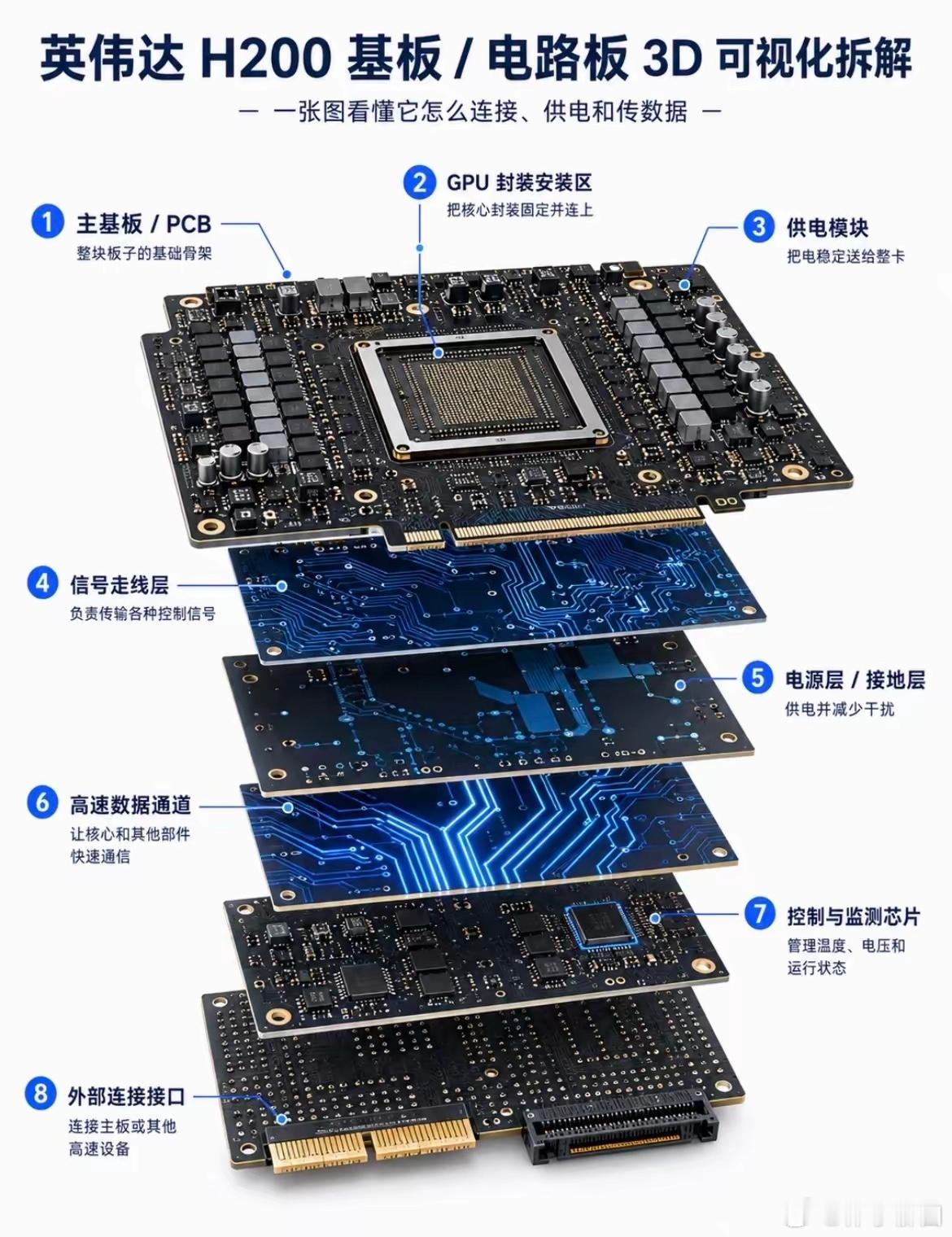

为大模型而生的NVIDIA H200,到底强在哪?它不是架构的全新迭代,而是Hopper架构的“内存革命”升级款,用更大的显存、更高的带宽,精准解决大模型时代的“内存瓶颈”。141GB HBM3e超大显存,轻松装下万亿级参数模型与长上下文KV Cache4.8TB/s超高带宽,让数据传输告别等待,大幅提升推理与训练效率4 PFLOPS FP8算力加持,兼顾强大的模型计算性能900GB/s NVLink互联,实现多卡高效协同,轻松扩展集群规模从大模型训练、长上下文处理,到高并发推理、企业级AI平台搭建,H200以“更大显存+更高带宽+强大算力”的组合,成为处理超大规模模型的理想选择,为AI基建按下加速键。